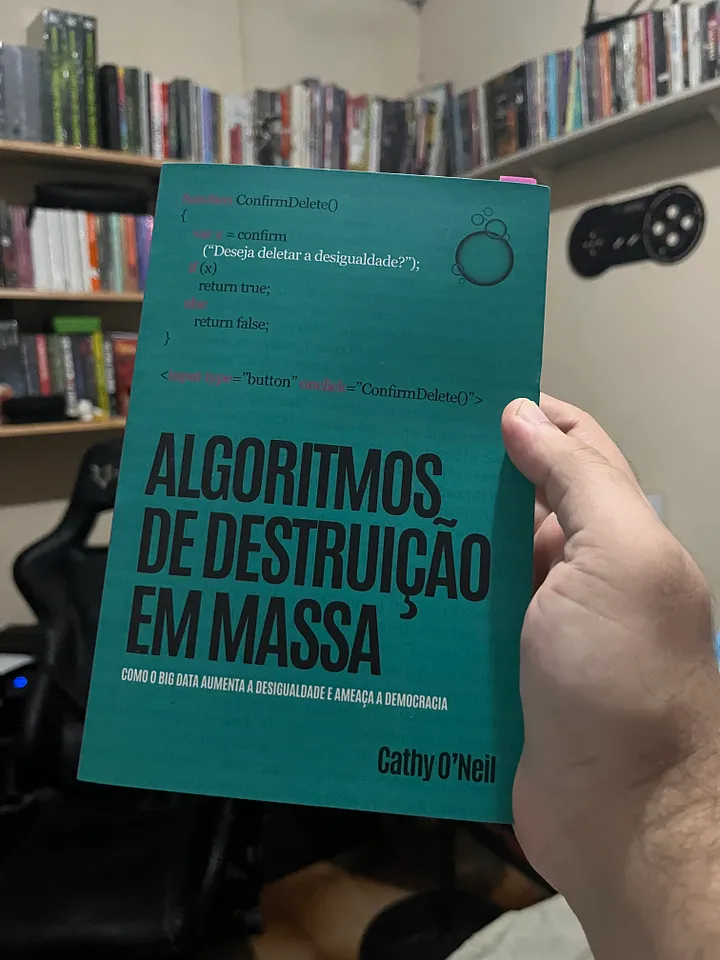

Título: Algoritmos de Destruição em Massa

Título Original: Weapons of math destruction: how big data increases inequality and threatens democracy.

Autor(a): Cathy O’Neil

Gênero: Não-Ficção, Algoritmos

Ano de Publicação: 2020

Ano de Publicação Original: 2020

Editora: Rua do Sabão

Número de Páginas: 342

ISBN: 9786586460025

Idioma Original: Inglês

Avaliação: 4.10/5.00

“Algoritmos de Destruição em Massa” de Cathy O’Neil explora como o Big Data e os algoritmos afetam a sociedade, aumentando a desigualdade e ameaçando a democracia. O’Neil, uma matemática e cientista de dados, descreve casos onde algoritmos opacos, não regulamentados e incontestáveis, classificados por ela como Armas de Destruição Matemática (ADM), perpetuam preconceitos e danos sociais.

O’Neil, com uma rara combinação de expertise em matemática e uma perspectiva crítica sobre tecnologia, define seu objetivo: revelar como algoritmos podem prejudicar a sociedade, especialmente os menos privilegiados. Seu trabalho é direcionado a leitores preocupados com a justiça social, ética em tecnologia e democracia.

Contexto e Relevância

Numa época dominada pelo Big Data, o livro é crucial para entender os riscos associados ao uso não regulamentado de algoritmos em decisões que afetam vidas humanas. A discussão é especialmente pertinente diante de crescentes preocupações com privacidade, vigilância e desigualdade social.

Um Apanhado Geral

Cathy O’Neil nos apresenta uma crítica penetrante à ascensão dos algoritmos como caixas pretas que, embora concebidos para otimizar e automatizar decisões em uma ampla gama de contextos sociais e econômicos, acabam por reforçar e perpetuar preconceitos, desigualdades e injustiças. Ela começa estabelecendo a premissa de que os modelos, essenciais em qualquer algoritmo, são abstrações simplificadas da realidade, projetadas para prever e guiar decisões. Contudo, adverte que esses modelos refletem os julgamentos, prioridades e, por vezes, os preconceitos de seus criadores, tornando sua eficácia e justiça uma questão de perspectiva.

A autora argumenta que a falta de transparência e a ausência de ciclos de feedback para correção de erros em muitos desses sistemas não só os torna opacos para aqueles que são avaliados por eles, mas também permite que esses modelos alimentem ciclos destrutivos de feedback, onde os “perdedores” designados pelo algoritmo são empurrados para situações cada vez piores, sem possibilidade de apelação ou correção. Ela ilustra essa dinâmica com exemplos que vão desde a publicidade predatória online, que se concentra nos mais vulneráveis, até a justiça penal, onde a localização geográfica se torna um proxy para a raça, perpetuando a segregação e as desigualdades sociais.

A autora também destaca o Paradoxo de Simpson, demonstrando como a análise de grandes conjuntos de dados pode revelar tendências enganosas quando desagregadas em subgrupos, desafiando a noção de que os algoritmos são inerentemente objetivos ou imparciais. Ela chama a atenção para a complexidade de medir o sucesso dos modelos, criticando a tendência de valorizar o lucro e a eficiência em detrimento da justiça e do bem-estar humano.

Além disso, O’Neil faz uma chamada à ação para os cientistas de dados, sugerindo a adoção de um juramento de Hipócrates para a ciência de dados, onde se comprometem a não sacrificar a realidade pela elegância matemática e a considerar os impactos sociais e econômicos de seu trabalho. Ela argumenta pela necessidade de integrar valores humanos como justiça e igualdade nos modelos matemáticos, afirmando que estes devem servir como ferramentas para melhorar a sociedade, e não como seus mestres.

O Modelo

De uma forma geral um modelo é como uma abstração de um processo usado para prever respostas em diversas situações, notando que todos nós utilizamos modelos mentais para guiar nossas decisões diárias.

O’Neil destaca que, embora os modelos sejam ferramentas úteis para simplificar as complexidades do mundo real, eles são inevitavelmente imperfeitos e refletem os julgamentos, prioridades e, potencialmente, os preconceitos de seus criadores. Isso levanta a questão de que a eficácia de um modelo é, em grande parte, uma questão de opinião, dependendo de como o sucesso é definido dentro do contexto específico para o qual o modelo é criado.

Os modelos podem reforçar crenças discriminatórias se não forem cuidadosamente monitorados e atualizados, levantando o questionamento se eles realmente eliminam o viés humano ou simplesmente o escondem sob linhas de código. O’Neil destaca a capacidade destrutiva dos modelos quando eles penalizam indevidamente grupos vulneráveis, criando ciclos de feedback negativos que validam e perpetuam suas próprias premissas injustas.

Ela critica a falta de transparência em muitos modelos algorítmicos, apontando que a incapacidade de explicar claramente como as decisões são tomadas pode levar a uma percepção de injustiça, mesmo quando os modelos funcionam como pretendido. A autora ilustra isso com modelos de sentença que, ao ignorar as circunstâncias individuais, ajudam a criar um ambiente que justifica suas próprias premissas.

Modelos Ineficientes

Os algoritmos, ao invés de democratizar oportunidades, frequentemente exacerbam a desigualdade, criando um cenário onde uma minoria privilegiada pode acumular ainda mais vantagens. mostrando o quão impactantes os modelos são para a sociedade.

O’Neil começa apontando que os algoritmos podem intensificar desigualdades ao favorecer aqueles que já estão em posição de vantagem, possuindo fortuna e controle significativo sobre os dados. Ela descreve um ciclo vicioso onde os algoritmos, longe de serem neutros, tendem a perpetuar e agravar as disparidades sociais e econômicas existentes.

Um dos problemas centrais que O’Neil destaca é a falta de rigor na quantificação da importância e do peso dos parâmetros em muitos modelos algorítmicos. Isso pode levar aos já mencionados ciclos destrutivos de feedback, onde os indivíduos ou entidades rotuladas negativamente por um algoritmo encontram-se em uma trajetória descendente, com dificuldades crescentes para reverter a sua situação.

Ela também discute como os algoritmos podem ser manipulados ou “burlados”, especialmente quando se baseiam em proxies, ou seja, medidas indiretas que não capturam adequadamente o objeto de análise. Isso pode levar a decisões baseadas em dados imprecisos ou enganosos.

Um exemplo citado por O’Neil é o “Efeito Flutie”, que ilustra como modelos em grande escala forçam a conformidade, criando uma competição feroz onde todos lutam para se alinhar às expectativas do modelo. Isso não apenas cria desequilíbrios, mas também incentiva comportamentos onde as regras são contornadas ou diretamente violadas para obter vantagem.

O capítulo também aborda a publicidade online predatória, enfatizando como os modelos de análise de dados massivos se concentram nos indivíduos mais desesperados e vulneráveis. Através de análises estatísticas, esses modelos visam identificar e explorar as fraquezas dos consumidores, maximizando o impacto dos anúncios para os anunciantes ao custo de potenciais danos duradouros para os alvos dessas campanhas.

O’Neil argumenta que a proliferação desses algoritmos e o poder que eles detêm sobre aspectos cruciais da vida cotidiana representam um “abalo chocante” na estrutura da sociedade. Em vez de servirem como ferramentas para melhorar a condição humana, muitos algoritmos tornam-se instrumentos de desigualdade, reforçando divisões e injustiças sob o véu da objetividade e eficiência.

Modelos por toda a parte

Até para cursar uma faculdade os modelos podem causar impactos. Como uma capacidade sem precedentes, os algoritmos podem, paradoxalmente, não aplicar o rigor necessário na quantificação da importância e do peso de seus parâmetros.

O’Neil também aborda a questão da concorrência exacerbada criada pelos modelos em escala, que forçam todos a se alinharem aos critérios do modelo com o objetivo de se classificarem melhor. Essa dinâmica cria um ambiente de competição feroz, onde pontos importantes podem ser negligenciados simplesmente porque não são relevantes para o modelo.

A discussão amplia para a arena da educação superior, onde os algoritmos têm o potencial de causar danos duradouros às pessoas, perpetuando ciclos de desvantagem e reforçando desigualdades. O’Neil critica a falta de transparência e a ausência de mecanismos de correção, que deixam pouca esperança para aqueles prejudicados pelos sistemas automatizados.

Publicidade

A publicidade online, potencializada por Modelos de Análise de Dados Massivos, explora as vulnerabilidades dos consumidores, com um foco particular nos mais desesperados e vulneráveis.

Uma técnica comum nesse contexto é o teste A/B, onde diferentes versões de uma campanha são testadas simultaneamente para determinar qual delas gera a melhor resposta do público. Esse método, embora não seja novo, ganha uma escala sem precedentes na internet, permitindo que os anunciantes alcancem milhões de consumidores com facilidade. A eficácia de uma campanha, medida por uma resposta tão pequena quanto 1% do público-alvo, pode significar o sucesso para os profissionais de marketing, dada a vasta população acessível online.

A internet é o maior laboratório que já existiu para pesquisar o consumidor e gerar leads, proporcionando aos anunciantes acesso a um volume de dados e uma capacidade de processamento que só os computadores modernos podem manejar. O uso de machine learning para processar milhões de pontos de dados permite uma segmentação e personalização extremamente precisas das campanhas publicitárias.

No entanto, O’Neil critica essas práticas por potencialmente afetar de maneira negativa e duradoura as pessoas alvo dessas campanhas. Quando os programas publicitários são projetados para identificar e explorar as fraquezas e vulnerabilidades dos consumidores, eles podem causar danos significativos.

Justiça

Cathy O’Neil aborda as implicações profundas do uso de dados massivos na justiça e como isso pode, inadvertidamente, reforçar a segregação e as desigualdades existentes na sociedade. O’Neil destaca como a localização geográfica tornou-se um proxy eficaz para a raça nas cidades segregadas, evidenciando como os sistemas algorítmicos podem perpetuar e até agravar a discriminação racial.

Ela discute a complexidade de estabelecer relações causais nos sistemas de justiça alimentados por dados, mencionando o exemplo da correlação entre a legalização do aborto nos anos 1970 e a queda na criminalidade nas décadas seguintes, conforme analisado em “Freakonomics”. Este exemplo serve para ilustrar como as interpretações de dados podem ser altamente contextuais e sujeitas a vieses nas análises.

O’Neil aponta para a discrepância na aplicação da lei, onde crimes de colarinho branco, muitas vezes cometidos por indivíduos de classes sociais mais altas, raramente são abordados pelos modelos de prevenção de crimes, que tendem a se concentrar em delitos cometidos por pessoas mais pobres. Essa abordagem resulta numa criminalização da pobreza, perpetuando a crença de que as ferramentas e sistemas em uso são justos e imparciais, quando na verdade podem estar reforçando injustiças.

Muitos modelos operam em um limbo entre eficácia e justiça, onde a justiça não é efetivamente calculada ou considerada em sua operação. O resultado é uma forma de injustiça passiva e industrial, onde as nuances e complexidades das situações humanas são ignoradas em favor de eficiências operacionais e resultados quantificáveis.

Embora alguns aspectos da justiça possam ser assistidos por dados e algoritmos, há elementos intrinsecamente humanos que não podem ser quantificados. A justiça, argumenta O’Neil, não deve ser imposta de cima para baixo por uma minoria privilegiada sobre a maioria, mas deve ser uma busca coletiva que reconheça e respeite a complexidade e dignidade de todas as pessoas.

Emprego

Cathy O’Neil discute como os sistemas de recrutamento baseados em algoritmos excluir candidatos qualificados com base em critérios injustos ou irrelevantes. Ela argumenta que, sem ciclos de feedback adequados, esses sistemas tornam-se “caixas pretas” inescrutáveis, classificando candidatos como inaptos com base em parâmetros que podem não ter relevância real para as habilidades ou capacidades necessárias para o trabalho.

A importância de compreender como esses algoritmos funcionam e de se adaptar a eles, é uma ideia um tanto absurda, mas a obscuridade de modelos pode levar a uma situação em que o conhecimento sobre o funcionamento do algoritmo é utilizado não para aprimorar o processo de seleção, mas para justificar decisões preconceituosas ou manter o status quo. Ela compara essa prática ao uso da frenologia no século XIX, uma pseudo ciência que afirmava poder determinar o caráter, as capacidades mentais e os traços de personalidade de uma pessoa com base na forma do crânio, ilustrando como as justificativas “científicas” podem ser usadas para reforçar preconceitos e exclusões sociais.

Na Vida

O livro explora a complexa interação entre algoritmos de otimização de lucro e a qualidade de vida dos trabalhadores. Ela detalha como os modelos usados pelas empresas para maximizar eficiências operacionais frequentemente resultam em horários de trabalho irregulares e imprevisíveis para os empregados, complicando significativamente a organização da vida pessoal e familiar desses indivíduos.

Destaca ainda, o impacto negativo desses horários irregulares na dinâmica familiar, afetando não apenas os próprios trabalhadores, mas também seus filhos e a estrutura familiar como um todo. A autora argumenta que a socialização e o descanso são cruciais não apenas para o bem-estar dos empregados, mas também para a produtividade no trabalho. No entanto, ela observa que os sistemas computacionais que gerenciam esses horários têm dificuldade em avaliar e incorporar a importância de tais fatores interpessoais e de bem-estar nos modelos que determinam os horários de trabalho.

Os modelos que falham em capturar a plenitude da experiência humana e as necessidades dos trabalhadores, levantando a questão de como a pontuação de um modelo pode ou não refletir a verdadeira qualidade do trabalho de uma pessoa. O’Neil aponta para a lacuna entre a capacidade dos algoritmos de medir aspectos quantificáveis do desempenho e sua incapacidade de valorizar componentes qualitativos cruciais para o sucesso organizacional e individual.

A autora faz uma crítica incisiva à tendência das empresas de ver os trabalhadores meramente como recursos a serem otimizados, em vez de como seres humanos com necessidades complexas e vidas fora do ambiente de trabalho. O’Neil argumenta pela necessidade de uma abordagem mais holística na gestão de recursos humanos, uma que reconheça a importância de equilibrar as demandas operacionais com o bem-estar dos empregados. Ainda chama a atenção para a desconexão entre as métricas de desempenho e a realidade vivida dos trabalhadores, destacando a necessidade de revisão e ajuste dos modelos algorítmicos que regem o local de trabalho moderno.

Vida Financeira

Os algoritmos, ao processar grandes volumes de dados pessoais, pretendem avaliar o risco de crédito de forma objetiva. No entanto, eles podem perpetuar e até exacerbar desigualdades já existentes.

Muitas vezes não existe uma distinção clara entre causalidade e correlação nos modelos preditivos de crédito. Muitos sistemas falham ao confundir correlação (relações estatísticas entre dados) com causalidade (uma relação causa-efeito), levando a decisões de crédito que podem ser injustas ou discriminatórias. Por exemplo, fatores como localização geográfica ou histórico de compras podem ser correlacionados com a pontuação de crédito, mas não necessariamente indicam a capacidade de pagamento de um indivíduo.

Pessoas de comunidades de baixa renda ou minorias raciais podem ser desproporcionalmente afetadas por algoritmos que utilizam variáveis correlacionadas com esses fatores socioeconômicos e demográficos, resultando em taxas de juros mais altas ou na negação de crédito para esse grupo.

As decisões algorítmicas em finanças não afetam apenas a capacidade de obter crédito, mas também têm implicações de longo prazo na vida das pessoas, afetando sua capacidade de comprar uma casa, iniciar um negócio ou até mesmo gerenciar emergências financeiras.

Sendo Segurado

Os algoritmos e o Big Data transformaram a indústria de seguros, focando especialmente em como essas tecnologias podem resultar em desigualdades, penalizando injustamente certos grupos de indivíduos baseados em critérios obscuros ou indiretos.

Pessoas que vivem em áreas consideradas de alto risco (muitas vezes correlacionadas com a pobreza ou com minorias étnicas) podem também ser consideradas de alto risco, mas não por causa de seu comportamento individual, mas devido a generalizações feitas por algoritmos.

Vida, o Voto

Os algoritmos podem na esfera pública e na vida cívica dos cidadãos, alterar e moldar opiniões, comportamentos e até o resultado de eleições, através do microdirecionamento algorítmico.

Os algoritmos para o microdirecionamento de anúncios políticos, permitem que campanhas direcionem mensagens altamente personalizadas a indivíduos específicos com base em seus dados pessoais, interesses e histórico de navegação. Este microdirecionamento pode amplificar o viés de confirmação, reforçando crenças existentes e dificultando o debate e a deliberação democrática, minando a confiança pública no processo eleitoral.

A personalização extrema de conteúdo online cria bolhas informativas que isolam os indivíduos de opiniões divergentes, enfraquecendo o tecido social e a capacidade de alcançar consensos em questões importantes, que podem definir os rumos de uma nação.

Finalizando

Cathy O’Neil reflete sobre os insights, enfatizando a necessidade de um ajuste ético nos modelos matemáticos que alimentam os algoritmos responsáveis por decisões críticas em nossas vidas. Ela argumenta que, embora estes modelos se baseiem em dados do passado, eles devem ser calibrados com valores que promovam a justiça e não aprofundem as desigualdades existentes.

Ela enfatiza a importância de reconhecer as limitações e as hipóteses subjacentes aos modelos, e a responsabilidade dos cientistas de dados em considerar os impactos sociais e econômicos de seu trabalho.

É de suma importância reavaliar o que é considerado um sucesso por esses modelos, criticando a ênfase excessiva em lucro e eficiência em detrimento de considerações mais humanas, como equidade e bem-estar comum. Sem a integração de valores humanos nos modelos matemáticos, o sistema resultante tende a ser punitivo e a perpetuar injustiças.

Comparação com Outras Obras

- “Automating Inequality: How High-Tech Tools Profile, Police, and Punish the Poor” por Virginia Eubanks: Este livro explora como os sistemas automatizados são usados para gerenciar a pobreza nos Estados Unidos, frequentemente resultando em mais vigilância e penalidades para os pobres, ao invés de oferecer suporte.

- “Hello World: Being Human in the Age of Algorithms” por Hannah Fry: Hannah Fry oferece uma visão acessível e ponderada sobre como os algoritmos influenciam vários aspectos da vida cotidiana, desde a justiça criminal até a arte.

- “The Age of Surveillance Capitalism: The Fight for a Human Future at the New Frontier of Power” por Shoshana Zuboff: Zuboff discute como o capitalismo de vigilância molda a tecnologia e a sociedade, transformando a experiência humana em dados para lucro e controle.

- “Race After Technology: Abolitionist Tools for the New Jim Code” por Ruha Benjamin: Este livro examina o impacto do racismo embutido na tecnologia e como isso perpetua a desigualdade, propondo caminhos para uma abordagem mais justa e inclusiva.

- “Data and Goliath: The Hidden Battles to Collect Your Data and Control Your World” por Bruce Schneier: Schneier explora a coleta em massa de dados pelas corporações e governos, discutindo as implicações para a privacidade, a liberdade e a segurança.

- “Algorithms of Oppression: How Search Engines Reinforce Racism” por Safiya Umoja Noble: Noble investiga como os mecanismos de busca, particularmente o Google, podem reforçar estereótipos racistas e sexistas, sugerindo a necessidade de regulamentações e abordagens alternativas.

Recomendações Finais

“Algoritmos de Destruição em Massa” é uma leitura essencial para quem deseja compreender os desafios éticos e sociais trazidos pela tecnologia digital. O’Neil conclama por maior transparência, regulamentação e ética no desenvolvimento e implementação de algoritmos, visando garantir que a tecnologia sirva à humanidade, e não o contrário. Recomendado para estudantes, profissionais de tecnologia, formuladores de políticas e qualquer pessoa interessada nos cruzamentos entre tecnologia, sociedade e justiça.